近日,必赢官方信息学院自动化与机器人中心(以下简称STAR 中心)在视觉感知、机器人操控、视觉实时定位与建图(SLAM)等领域取得多项研究成果,相关论文被2023 IEEE/RSJ International Conference on Intelligent Robots and Systems(以下简称:IROS 2023)接收。IROS 是机器人领域一个极具影响力的国际学术会议,旨在探索智能机器人和智能机器的科学技术前沿,着重关注未来方向以及最新的方法、设计和成果。IROS 2023将于2023年10月1日至5日在美国底特律举办。

视觉SLAM

1. 图像配准方法

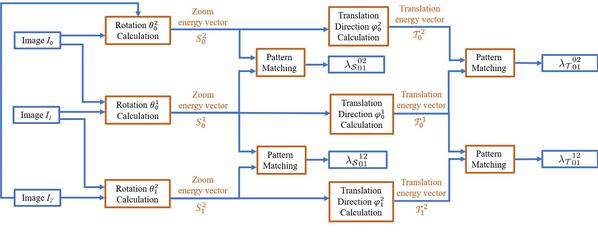

随着机器人应用的不断增加,稳定高效的视觉里程计(VO)算法越来越重要。基于傅里叶梅林变换(FMT) 算法的扩展傅里叶梅林变换 (eFMT),是一种图像配准方法。研究人员通过改进配准方式、目标函数以及不确定度估计,并添加三连续帧的小循环的位姿优化,提出了一种改进的新算法o-eFMT。系列实验证实了该算法的准确性和高效性。成果题为“Optimizing the extended Fourier Mellin Transformation Algorithm”,信息学院2023届硕士毕业生姜文青、2021级硕士研究生李承谦为共同第一作者,2023届硕士毕业生曹今玥参与了该科研项目,Sören Schwertfeger教授为通讯作者。

文章链接:https://arxiv.org/abs/2307.10015

图 | o-eFMT图像配准流程图

2. 位姿图优化

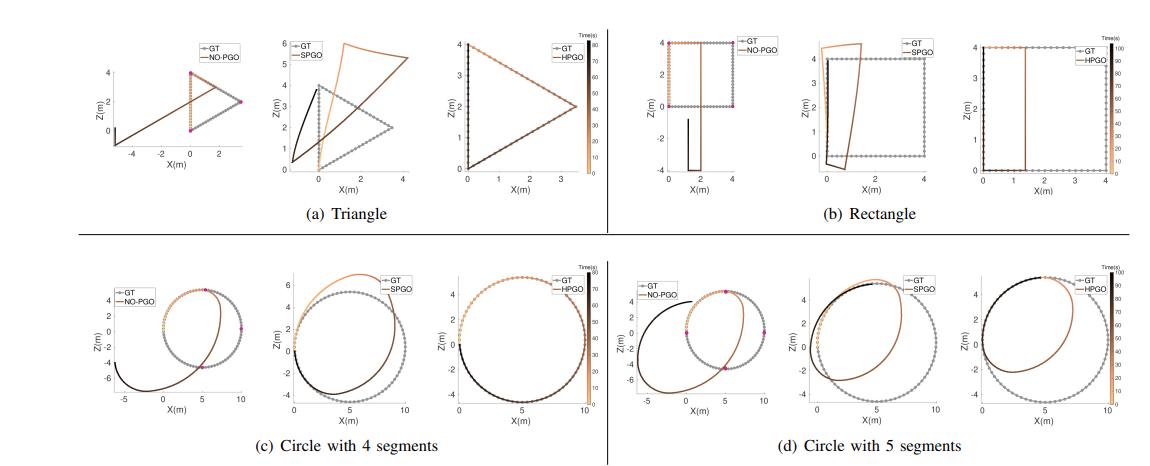

由于相机具有成本低、重量轻、能耗低等优势,与多传感器SLAM相比,单目视觉SLAM解决方案通常更具吸引力。但单目视觉SLAM在几何上具有尺度不确定的问题,尺度的确定依赖于系统初始化的场景。当SLAM系统中有多段在不同场景下初始化得到的轨迹和地图时,它们往往有不一致的尺度,即尺度跳变(scale-jump)。而在同一段轨迹中尺度会随着时间变化渐渐不一致,称为尺度漂移(scale-drift)。尺度漂移感知的姿态图优化(SPGO)是Strasdat在2010年提出的一种修复尺度漂移的位姿图优化框架。

研究人员在此基础上提出了一种可以同时修复scale-drift和scale-jump的图优化框架 (HPGO),该算法改进了目标函数,并在此基础上进行了可行性分析。该优化框架被融合进了ORBSLAM系统中,并证实了在真实场景下实时运行的可能性。成果以“Scale jump-aware pose graph relaxation for monocular SLAM with re-initializations”为题被接收, 信息学院2021级硕士研究生袁润泽为第一作者,Laurent Kneip教授为通讯作者。

文章链接:https://arxiv.org/abs/2307.12326

Demo和代码:https://github.com/peteryuan123/HPGO-ORBSLAM3

图 | HPGO在模拟数据集中的表现

机器人操控

1. 微纳尺度机器人

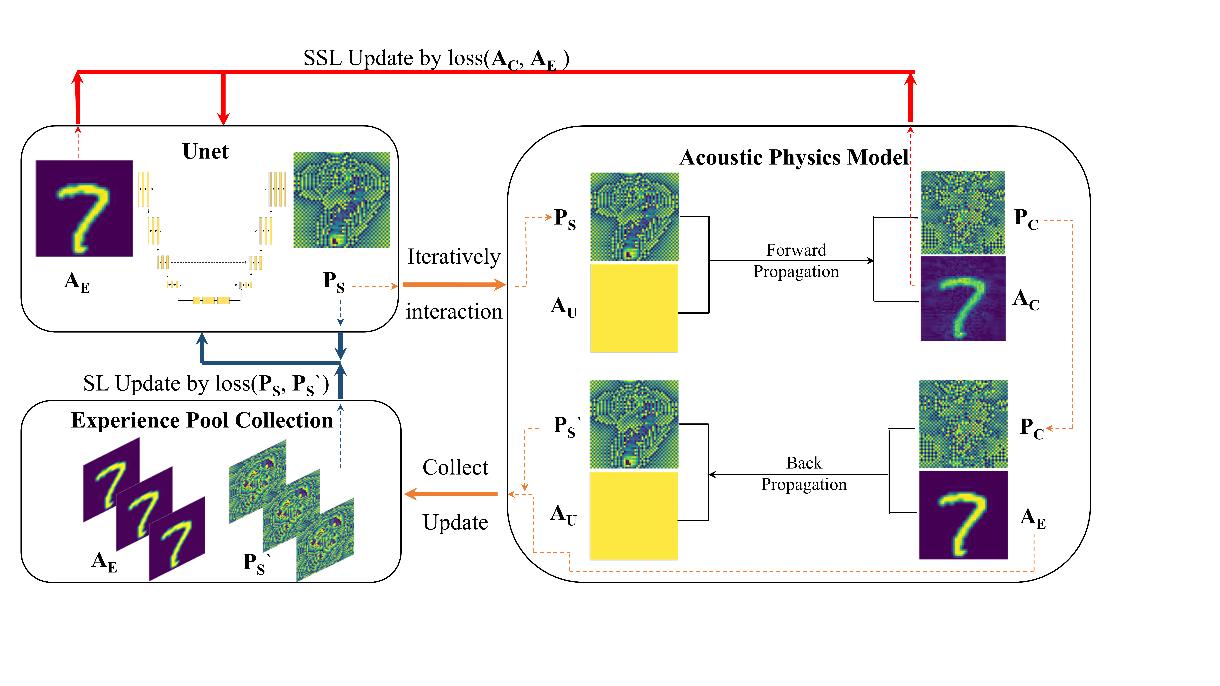

相对于传统的接触式机器人,基于声场的非接触式机器人将操作延伸到了微纳尺度,声波更是赋予了微纳机器人穿透非透明物体的能力和优秀的生物兼容性。声全息技术则提供了一种从二维声全息图恢复三位声场的方法。由于硬件限制和对重建声场高保真度的需求,相比于对相位幅值均进行调制的全息图,仅相位全息图是更优的选择。

研究人员提出了一种基于深度学习的实时仅相位声全息算法,并将物理模型角谱法引入神经网络的训练之中以满足声波传播的物理特性。算法由自监督学习、经验池收集、监督学习三部分组成,三者迭代优化从而高效且精准地重建出所需声场。其中,自监督学习可避免昂贵的获取标注数据集的工作,而经验池收集则为后续监督学习提供了数据和标签。该成果以“Ultrafast Acoustic Holography with Physics-Reinforced Self-Supervised Learning for Precise Robotic Manipulation”为题被接收,信息学院2023届本科毕业陆清怡和2021级研究生钟承希为共同第一作者,信息学院2022级研究生刘晴和信息学院助理研究员李腾老师参与了该项目,中国科学院自动化研究所苏虎教授和上科大信息学院刘松教授为通讯作者。

图|基于物理模型强化的自监督学习框架

2. 鱼形机器人

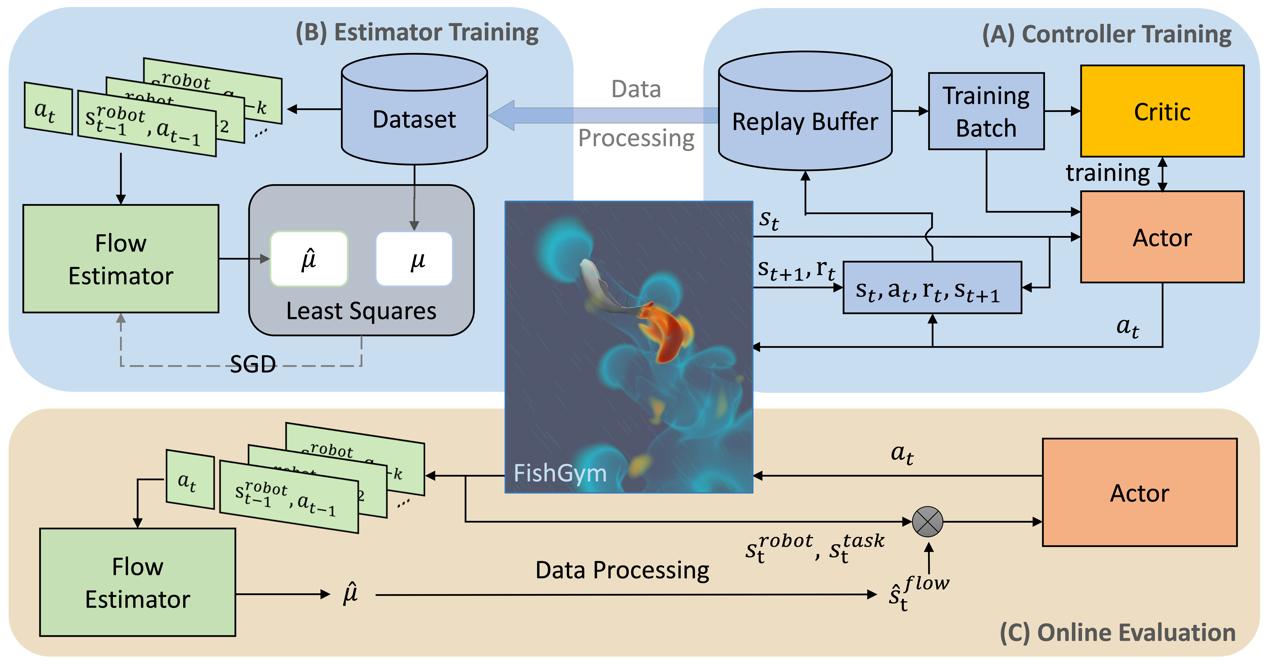

机器鱼具有较强的机动性、推进效率和欺骗性的视觉外观。为了提高机器鱼在各种极端环境下的性能,进一步研究其在复杂流场中的运动控制,研究人员提出了一种新的基于学习的控制框架,可以自主探索有效控制策略,使其能够在非静态和未知大小的背景流场中执行运动控制任务。仿真结果表明,通过所提出的学习框架,机器鱼成功地获得了一种可用于适应不同背景流和任务的游泳策略。此外,研究人员还观察到机器鱼的一些适应行为,如流变性(Rheotaxis),这与自然界中的鱼类相似,便于研究人员更深入地了解鱼类在复杂环境中适应行为的机制。成果以“Exploring Learning-based Control Policy for Fish-like Robots in Altered Background Flows”为题发表,信息学院2021级硕士研究生林霄竹为第一作者,汪阳教授为通讯作者。

图|本文提出的框架

视觉感知

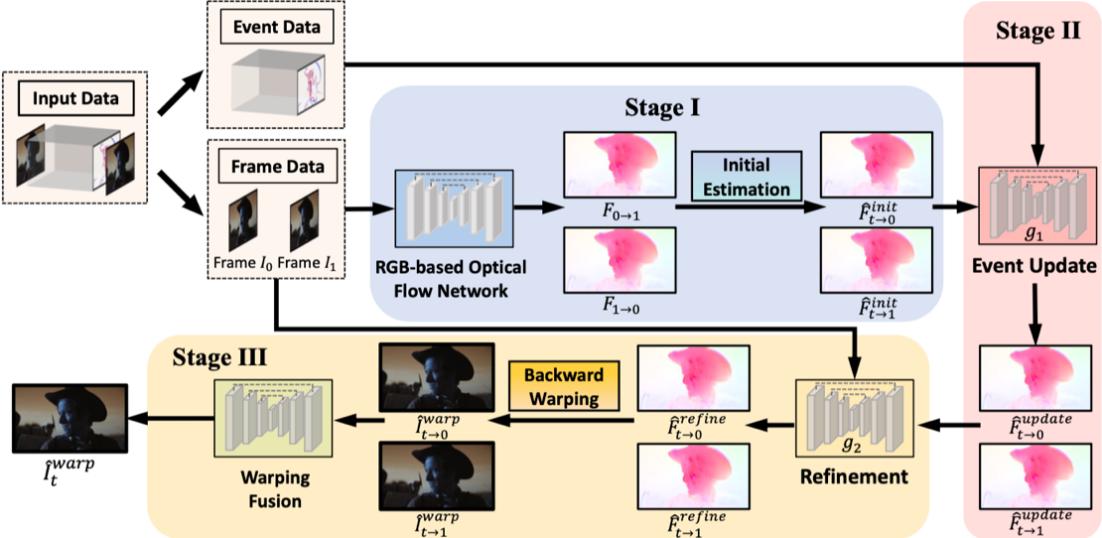

作为一种新型传感器,事件相机具有高动态范围和高时间分辨率等特点,能为视频帧插任务提供丰富的补充信息。为了提升视频插帧效果的真实性,研究人员探索了事件信息的内在特性,并结合基于合成的方法和基于光流的方法,提出了两种新的策略模块:代理引导的合成策略,可以逐步合成中间帧以有效地结合局部和全局的时间信息;事件引导的光流精炼策略使用事件流来校准从RGB图像中得到的光流估计。实践证明,该方法在合成数据集和真实世界数据集都展示了更真实的中间插帧结果。

图|事件引导的光流精炼模块的结构示意图

该成果以“Revisiting Event-based Video Frame Interpolation”为题被接收。信息学院2018级本科生陈嘉本为第一作者、2018级本科生朱奕辰为第二作者,信息学院2018级博士生廉东泽、2018级本科生杨家琪、刘新航和2019级研究生钱深瀚、博士后王义夫参与了该科研项目,Laurent Kneip教授参与指导了该工作。高盛华教授为通讯作者。

文章链接:https://arxiv.org/abs/2307.12558

项目主页:https://jiabenchen.github.io/revisit_event

沪公网安备 31011502006855号

沪公网安备 31011502006855号